Google Agentic Era Hackathon: Unser KI-Anwendungsfall – Live API im Einzelhandel

Einleitung

KI-Anwendungen und insbesondere Agenten bieten spannende Möglichkeiten, die Interaktion mit Technologie neu zu gestalten. Die schnelle Entwicklung von Prototypen steht jedoch oft im Kontrast zur komplexen Aufgabe, diese in produktionsreife Lösungen zu überführen. Eine zuverlässige und vertrauenswürdige Interaktion ist dabei entscheidend, insbesondere angesichts der Herausforderungen, die mit dem „Blackbox“-Verhalten von Large Language Models (LLMs) verbunden sind.

Der Google Agentic Era Hackathon: Eine Plattform für Innovation

Am 18. März 2025 lud Google Entwicklerteams aus ganz Europa zum Agentic Era Hackathon ein. Die Veranstaltung fand sowohl remote als auch vor Ort in London, Paris, Madrid, Mailand und Tel Aviv statt. Einzelpersonen und Teams stellten sich der Herausforderung, auf Basis des Agent Starter Packs einen Agenten zu entwickeln.

Das Agent Starter Pack: Ein guter Ausgangspunkt für die Entwicklung von KI-Agenten

Das Agent Starter Pack für die Google Cloud bietet eine Sammlung von Vorlagen für generative KI-Agenten, die als Ausgangspunkt für die Entwicklung und den Einsatz in verschiedenen Umgebungen dienen können. Es bietet Hilfestellung für gängige Herausforderungen wie Bereitstellung, Betrieb, Evaluierung, Anpassung und Überwachung.

Unser Projekt: Erkundung intelligenter Interaktion im Einzelhandel

Unser Team hat das Agent Starter Pack genutzt, um einen Agenten auf Basis der Multimodal Live API von Google zu entwickeln. Dieser Agent ist in der Lage, Video-, Audio- und Textdaten in Echtzeit zu verarbeiten.

Unsere Idee: Ein In-Store Terminal, das Kunden in Warenhäusern eine neue Art der Interaktion ermöglichen könnte. Hier ein Beispiel:

- Kunde: „Ich suche eine Jacke für Damen.“

- Agent: „Wir führen eine Auswahl an Jacken. Für welchen Zweck benötigen Sie die Jacke?“

- Kunde: „Für den täglichen Gebrauch, aber sie sollte auch wasserabweisend sein, da ich sie gelegentlich zum Wandern trage.“

- Agent: „In diesem Fall empfehlen wir Ihnen eine Outdoorjacke. Diese finden Sie in der 3. Etage im Bereich Outdoor-Bekleidung, direkt links neben der Rolltreppe.“

Produkterkennung: Eine interessante Möglichkeit

Eine weitere interessante Funktion, die wir implementiert haben, ist die Produkterkennung. Kunden halten ein Produkt vor das Terminal, und die KI identifiziert es – nicht nur als „bunte Laufschuhe von Adidas“, sondern mit dem exakten SKU-Code. Dies könnte beispielsweise die Online-Bestellung eines Artikels ermöglichen, der im Geschäft nicht mehr in der gewünschten Größe verfügbar ist.

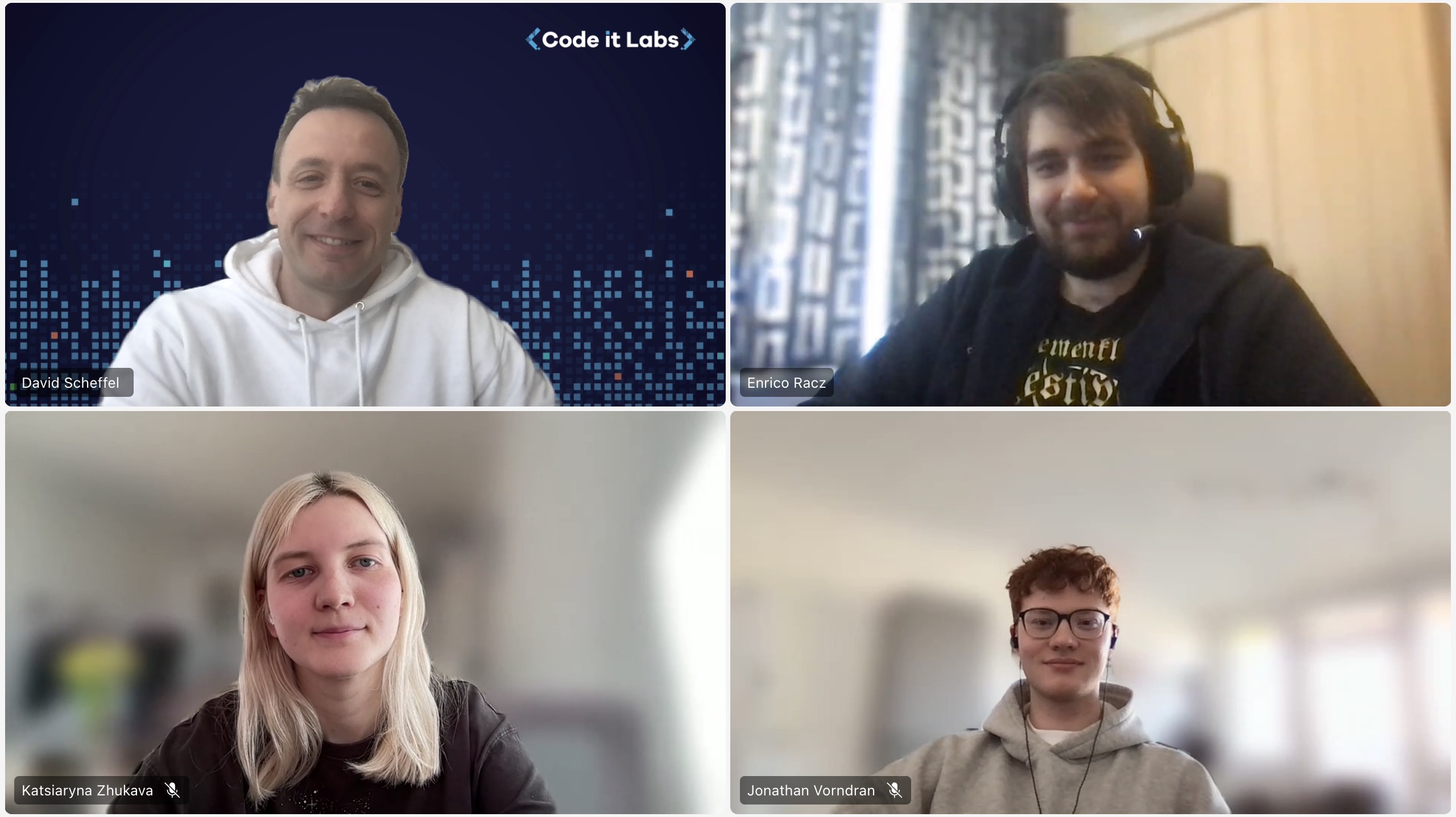

Vorstellung und Demo

Technologie im Detail

Für die Umsetzung haben wir die folgenden Google Modelle (https://cloud.google.com/vertex-ai/generative-ai/docs/learn/models) verwendet:

- Basismodell: Gemini 2.0 Flash

- Dialogführung: real-time streaming Live API

- Wissensdatenbank: Vektor-Indexierung mit text-embedding-004, Function Calling

- Produkterkennung: Vektorisierung von Produktbildern mit multimodalembedding@001, Function Calling

Fazit und Ausblick

Der Google Agentic Era Hackathon war eine interessante Erfahrung. Wir beobachten die Entwicklung des Agent Starter Packs bereits seit einiger Zeit und waren gespannt, nun zum ersten Mal mit der Multimodal Live API zu arbeiten. Das Potenzial dieser Technologie ist erheblich. Unser KI-Anwendungsfall – Live API im Einzelhandel und dabei insbesondere die Bilderkennung bei Live-Interaktionen lässt sich möglicherweise auf andere Bereiche übertragen. Wir sind gespannt auf die zukünftige Entwicklung und werden diese aufmerksam verfolgen.

Interesse an KI-Agenten?

Wenn Sie mehr über unsere Arbeit im Bereich KI-Agenten erfahren möchten, stehen wir Ihnen gerne für ein Gespräch zur Verfügung.